GPTDAOCN-e/acc on Nostr: 掌握机器学习算法的核心:一图胜千言 ...

掌握机器学习算法的核心:一图胜千言

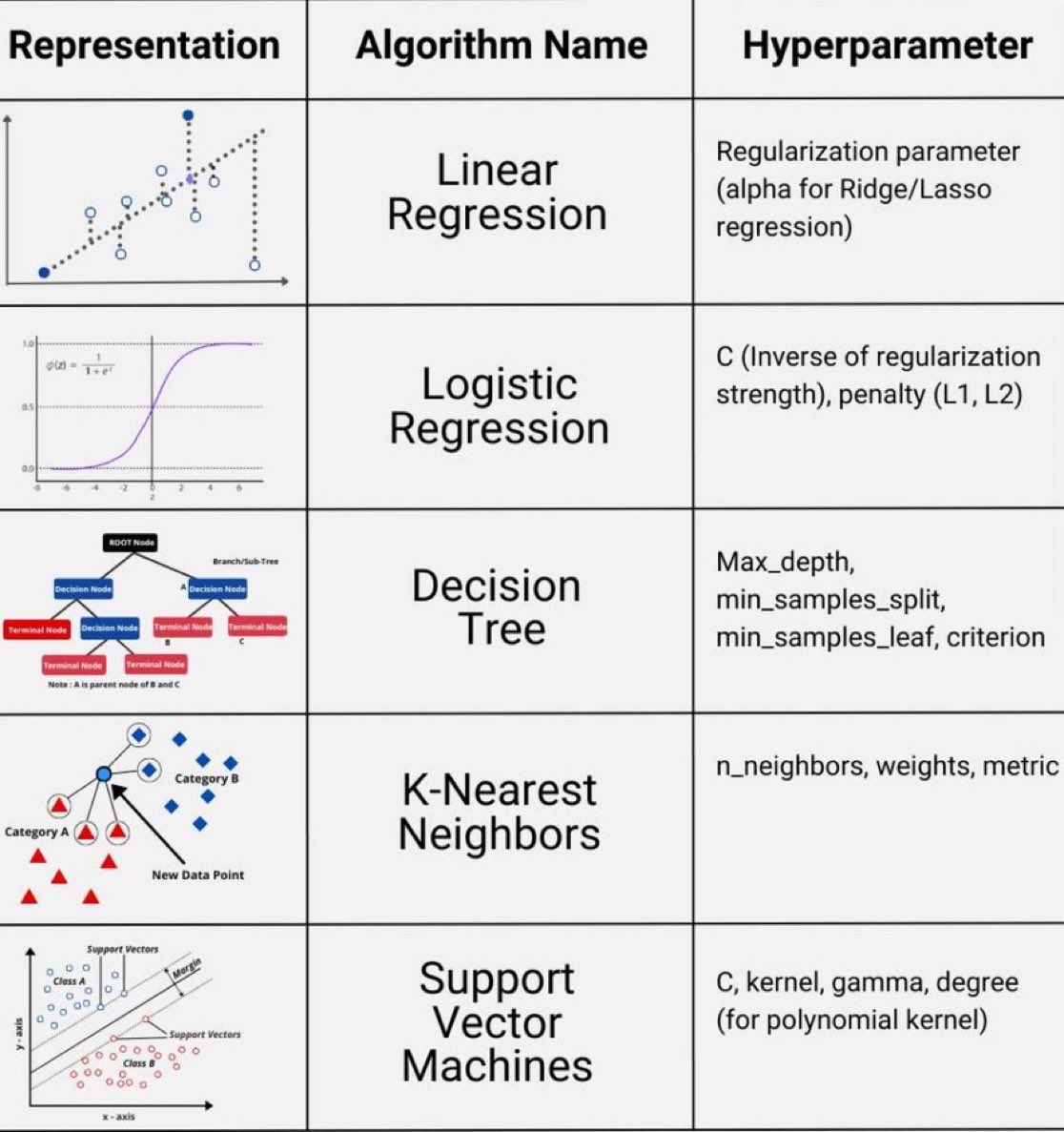

这张图展示了五种常见的机器学习算法,分别为线性回归、逻辑回归、决策树、K近邻和支持向量机。每种算法都有其独特的表示方式和关键超参数。

1. 线性回归 (Linear Regression)

- 表示:通过拟合直线预测目标变量。

- 超参数:正则化参数(如Ridge/Lasso回归中的alpha)。

2. 逻辑回归 (Logistic Regression)

- 表示:使用S形曲线将输入映射到概率。

- 超参数:C(正则化强度的倒数)、惩罚项(L1, L2)。

3. 决策树 (Decision Tree)

- 表示:树状结构,节点代表决策点或终端结果。

- 超参数:最大深度、最小样本分割数、最小样本叶子数、标准。

4. K近邻 (K-Nearest Neighbors)

- 表示:基于邻居的类别进行分类。

- 超参数:邻居数n_neighbors、权重、度量标准。

5. 支持向量机 (Support Vector Machines)

- 表示:通过最大化边距来分隔不同类别。

- 超参数:C(误差惩罚系数)、核函数类型、gamma、度数(多项式核时)。

这张图不仅帮助我们快速了解每种算法的特点,还能指导我们选择和调整相应的超参数,以优化模型性能。

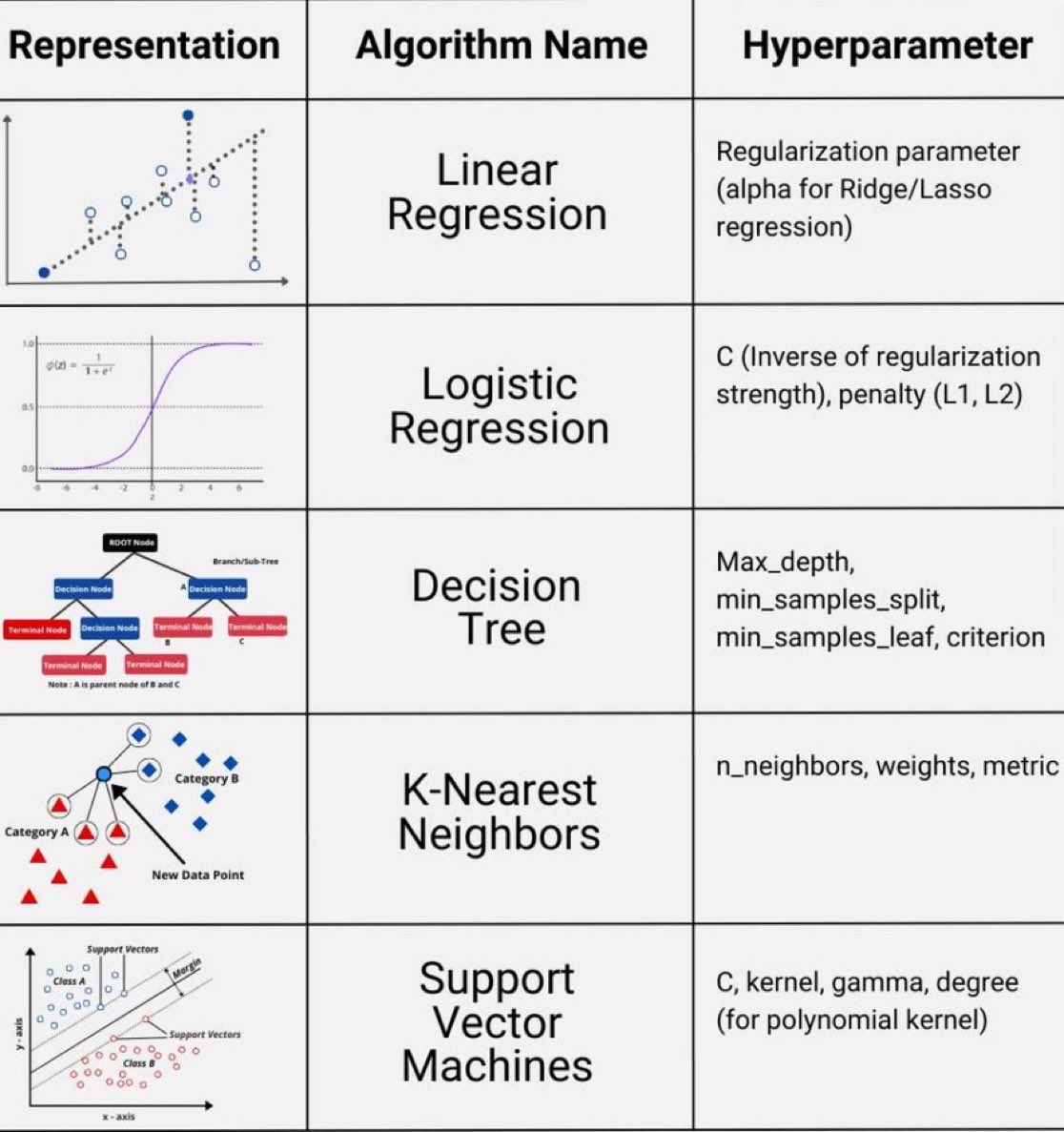

这张图展示了五种常见的机器学习算法,分别为线性回归、逻辑回归、决策树、K近邻和支持向量机。每种算法都有其独特的表示方式和关键超参数。

1. 线性回归 (Linear Regression)

- 表示:通过拟合直线预测目标变量。

- 超参数:正则化参数(如Ridge/Lasso回归中的alpha)。

2. 逻辑回归 (Logistic Regression)

- 表示:使用S形曲线将输入映射到概率。

- 超参数:C(正则化强度的倒数)、惩罚项(L1, L2)。

3. 决策树 (Decision Tree)

- 表示:树状结构,节点代表决策点或终端结果。

- 超参数:最大深度、最小样本分割数、最小样本叶子数、标准。

4. K近邻 (K-Nearest Neighbors)

- 表示:基于邻居的类别进行分类。

- 超参数:邻居数n_neighbors、权重、度量标准。

5. 支持向量机 (Support Vector Machines)

- 表示:通过最大化边距来分隔不同类别。

- 超参数:C(误差惩罚系数)、核函数类型、gamma、度数(多项式核时)。

这张图不仅帮助我们快速了解每种算法的特点,还能指导我们选择和调整相应的超参数,以优化模型性能。